Современный интерфейс «мозг-машина», созданный нейробиологами Университета Сан-Франциско, может генерировать естественную синтетическую речь, используя мозговую активность для управления виртуальным голосовым трактом — анатомически детализированное компьютерное моделирование, включая губы, челюсть, язык и гортань. Обучение проводилось на участниках исследования с неповрежденной речью, но технология могла в один прекрасный день восстановить голоса людей, потерявших способность говорить из-за паралича или других форм неврологических повреждений.

Инсульт, черепно-мозговая травма и нейродегенеративные заболевания, такие как болезнь Паркинсона, рассеянный склероз и боковой амиотрофический склероз (ALS или болезнь Лу Герига) часто приводят к необратимой потере способности говорить. Некоторые люди с серьезными нарушениями речи учатся излагать свои мысли буква за буквой, используя вспомогательные устройства, которые отслеживают очень маленькие движения глаз или лицевых мышц. Однако создание текста или синтезированной речи с помощью таких устройств является трудоемким процессом, подверженным ошибкам и болезненно медленным, обычно позволяя выдавать максимум 10 слов в минуту по сравнению со 100-150 словами в минуту естественной речи.

Новая система, разрабатываемая в лаборатории Эдварда Чанга, MD-описанная 24 апреля 2019 года в Nature — демонстрирует, что можно создать синтезированную версию голоса человека, которая может управляться активностью речевых центров его мозга. В будущем такой подход мог бы не только восстановить свободное общение с людьми с тяжелой речевой инвалидностью, говорят авторы, но и воспроизвести некоторую музыкальность человеческого голоса, который передает эмоции и личность говорящего.

«Это исследование впервые демонстрирует, что мы можем генерировать целые разговорные предложения, основанные на активности мозга человека», — сказал Чанг, профессор неврологической хирургии и член Института Неврологии UCSF Weill. «Это волнующее доказательство принципа, что с технологией, которая уже в пределах досягаемости, мы должны быть в состоянии построить устройство, которое клинически жизнеспособно у пациентов с потерей речи.»

Виртуальный Вокальный Тракт Улучшает Натуралистический Синтез Речи

Исследованием руководили к.м.н. Гопала Ануманчипалли и аспирант-биоинженер Джош Шартье из лаборатории Чанга. Оно основано на другом недавнем исследовании, в котором пара впервые описала как речевые центры в мозгу человека управляют движениями губ, челюсти, языка и другими частями вокального тракта, чтобы произвести беглую речь.

Из этой работы Ануманчипалли и Шартье поняли, что предыдущие попытки непосредственно декодировать речь из мозговой деятельности могли иметь ограниченный успех, потому что эти области мозга непосредственно не представляют акустические свойства речевых звуков, а скорее инструкции, необходимые для координации движений рта и горла во время речи.

«Связь между движениями голосового тракта и звуками речи, которые производятся, является очень сложной», — сказал Ануманчипалли. «Мы рассудили, что если эти речевые центры в мозгу кодируют движения, а не звуки, мы должны попытаться сделать то же самое при декодировании этих сигналов.»

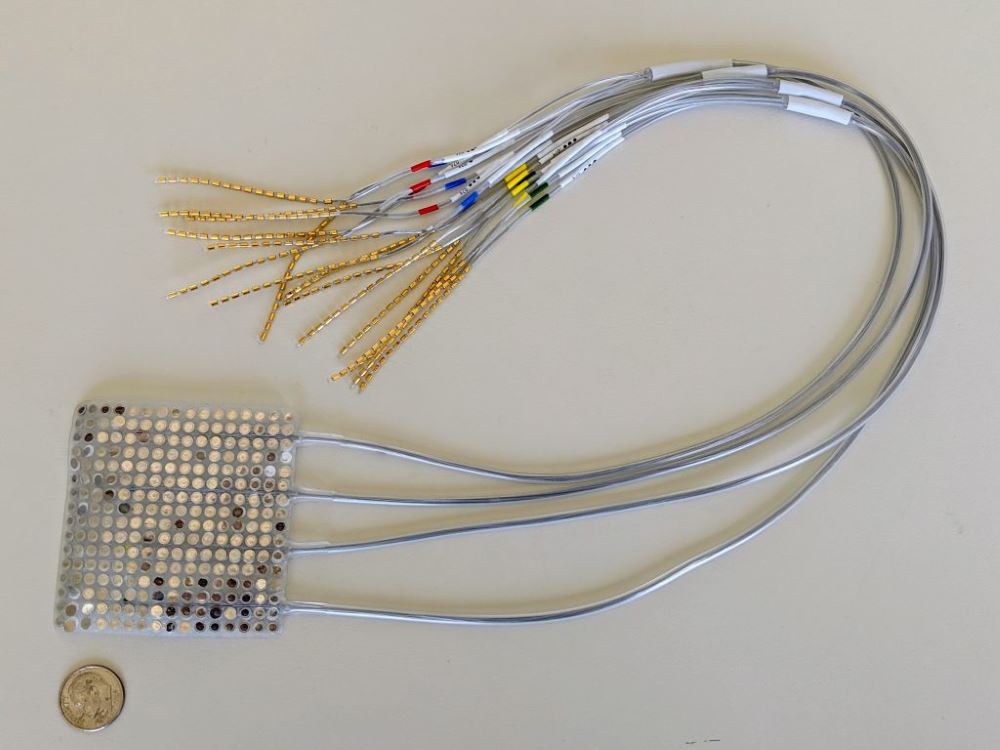

В своем новом исследовании Анумансипали и Шартье попросили пятерых добровольцев, проходивших лечение в центре эпилепсии UCSF — пациентов с неповрежденной речью, которым временно имплантировали электроды в мозг, чтобы отобразить источник их припадков при подготовке к нейрохирургии, — прочитать вслух несколько сотен предложений, в то время как исследователи регистрировали активность из области мозга, которая, как известно, участвует в производстве языковой речи.

Основываясь на аудиозаписях голосов участников, исследователи использовали лингвистические принципы для обратного проектирования движений голосовых путей, необходимых для производства этих звуков: сжатие губ здесь, сжатие голосовых связок там, перемещение кончика языка к небу, затем его расслабление и так далее.

Это детальное сопоставление звука с анатомией позволило ученым создать реалистичный виртуальный голосовой тракт для каждого участника, который мог бы управляться их мозговой активностью. Это включало два алгоритма машинного обучения «нейронной сети»: декодер, который преобразует паттерны мозговой активности, полученные во время речи, в движения виртуального голосового тракта, и синтезатор, который преобразует эти движения голосового тракта в синтетическое приближение голоса участника.

Исследователи обнаружили, что синтетическая речь, создаваемая этими алгоритмами, была значительно лучше, чем синтетическая речь, непосредственно декодированная из мозговой деятельности участников без включения моделирования голосовых путей говорящих. Алгоритмы создавали предложения, которые были понятны сотням человеческих слушателей в краудсорсинговых тестах транскрипции, проведенных на платформе Amazon Mechanical Turk.

Как и в случае с естественной речью, транскрипторы были более успешны, когда им давали более короткие списки слов на выбор, как это было бы в случае с ухаживающим персоналом, которые настроены на типы фраз или запросов, которые могут произносить пациенты. Транскрипторы точно определили 69% синтезированных слов из списков 25 альтернатив и 43% предложений с идеальной точностью. С более сложными 50 словами в целом точность транскрипторов опустился до 47%, хотя они все еще были в состоянии точно понять 21 процент синтезированных предложений.

«У нас все еще есть способы идеально имитировать разговорный язык, — признал Шартье. — Мы довольно хорошо синтезируем медленные звуки речи, такие как «Ш » и «З», а также поддерживаем ритмы и интонации речи, пол и личность говорящего, но некоторые из более резких звуков, таких как » Б » и «П», становятся немного нечеткими. Тем не менее, уровень точности, который мы воспроизвели здесь, будет великолепным улучшением в общении в реальном времени по сравнению с тем, что доступно в настоящее время.»

Искусственный интеллект, лингвистика и нейробиология способствовали прогрессу

В настоящее время исследователи экспериментируют с электродными массивами более высокой плотности и более продвинутыми алгоритмами машинного обучения, которые, как они надеются, еще больше улучшат синтезированную речь. Следующий важный тест для этой технологии — определить, может ли кто-то, кто не может говорить, научиться использовать систему, не будучи в состоянии обучить ее своему собственному голосу и заставить ее обобщать все, что они хотят сказать.

Предварительные результаты одного из участников исследования команды предполагают, что анатомически основанная система исследователей может декодировать и синтезировать новые предложения из мозговой активности участников почти так же, как и предложения, на которых был обучен алгоритм. Даже когда исследователи предоставили алгоритму данные о мозговой активности, записанные в то время, как один участник просто произносил предложения без звука, система все еще могла производить понятные синтетические версии мимических предложений в голосе говорящего.

Исследователи также обнаружили, что нейронный код для голосовых движений частично перекрывается между участниками, и что моделирование голосовых путей одного объекта исследования может быть адаптировано для ответа на нейронные инструкции, записанные из мозга другого участника. Вместе эти результаты показывают, что люди с потерей речи из-за неврологических нарушений могут научиться управлять речевым протезом, смоделированным по голосу человека с неповрежденной речью.

«Люди, которые не могут двигать руками и ногами, научились управлять конечностями роботов своим мозгом», — сказал Шартье. «Мы надеемся, что однажды люди с нарушениями речи смогут снова научиться говорить, используя этот искусственный голосовой тракт, управляемый мозгом.»

Ануманчипалли добавил: «Я горжусь тем, что мы смогли объединить опыт нейробиологии, лингвистики и машинного обучения в рамках этой важной вехи на пути к оказанию помощи неврологически инвалидам.»

Источник: University of California — San Francisco